Crawler

作成: 2026.03.24更新: 2026.03.24

1. 概要

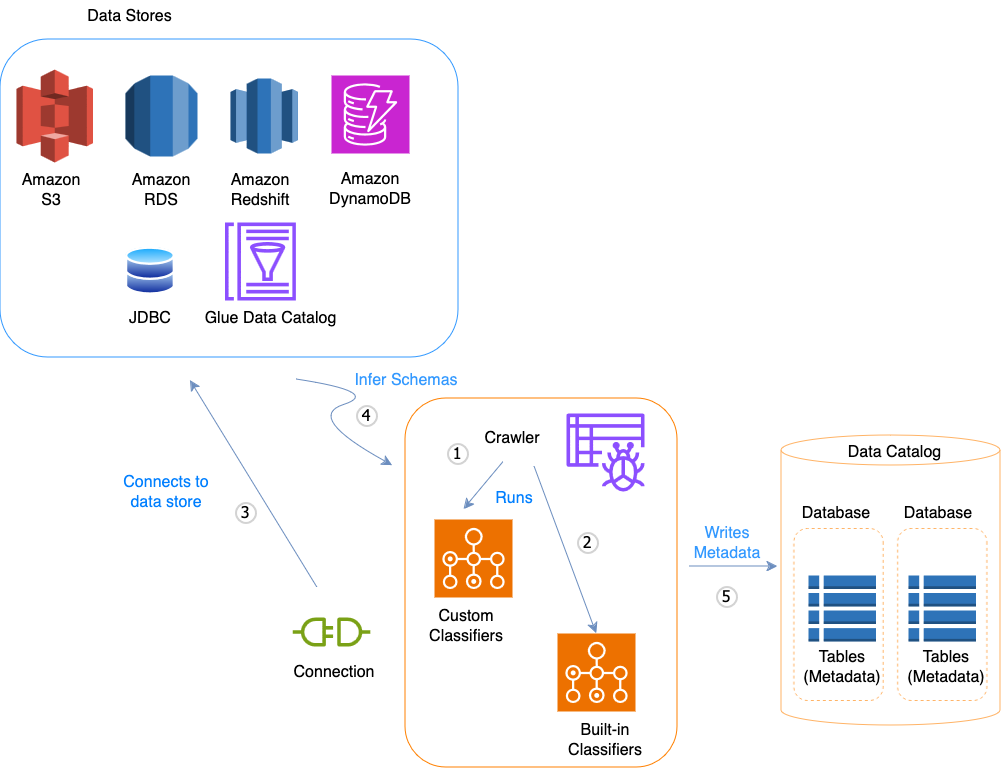

AWS Glue Crawler は、データソースを自動的にスキャンし、スキーマ(カラム名・データ型)を推定して Data Catalog にテーブル定義を登録・更新するコンポーネント。

データレイクに新しいデータソースを追加するたびに手動でスキーマ定義を行う手間を省き、メタデータ管理を自動化する。

2. 対応データソース

| データソース | 説明 |

|---|---|

| Amazon S3 | CSV、JSON、Parquet、Avro、ORC 等のファイル |

| JDBC | RDS、Redshift、外部データベース |

| DynamoDB | DynamoDB テーブル |

| MongoDB / DocumentDB | ドキュメントデータベース |

| Kafka / Kinesis | ストリーミングデータ |

3. 設定のポイント

スケジュール

Crawler の実行頻度は、データソースの更新頻度に合わせて設定する。

- 日次更新のデータ:

cron(0 0 * * ? *)— 毎日深夜に実行 - リアルタイム更新のデータ: EventBridge でイベント駆動にするか、頻度を上げる

- ほぼ変更されないデータ: オンデマンド実行で十分

除外パターン

S3 をクロールする際、一時ファイルや中間ファイルを除外する設定が重要。

_temporary/**

_spark_metadata/**

*.crc